基地局を「AIの頭脳」へ変えるソフトバンクの挑戦 1台で20基地局制御、夜間はGPUをAI計算に転用へ

例えば、横断歩道前の停車車両があるケースでは、日本の交通法規を踏まえ「歩行者が飛び出してくる可能性があるため、一時停止が必要」といった判断を行い、自動運転オペレーターの管理画面に提示する。

「車両側の計算能力を増強せずに、高度な判断が可能になる」とソフトバンク 先端技術研究所の山科瞬氏は説明する。自動運転車に搭載できる計算機には限界があるが、基地局側で高度な処理を行うことで、この制約を解消できる。

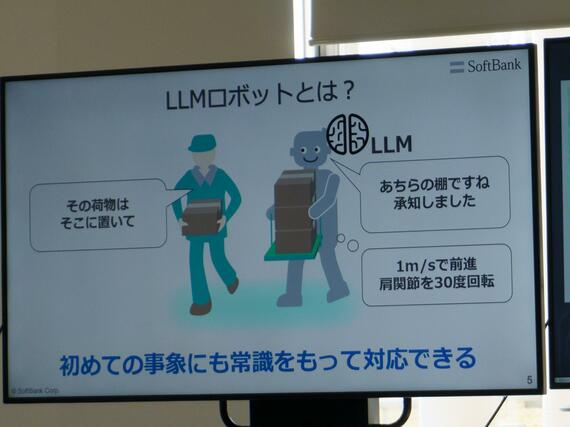

もう1つは警備ロボットの遠隔制御だ。通常のクラウド経由でLLM(大規模言語モデル)を使ったロボット制御を行うと、指示を出してから動作するまでに数百ミリ秒の遅延が発生する。オンラインゲームでいう「ラグ」のような状態で、ロボットの反応を見ながら適切な制御を行うことが難しい。基地局でAI処理を行うことでこの遅延を約100ミリ秒まで短縮。ロボットの動きを確認しながらスムーズに操作できるようになった。

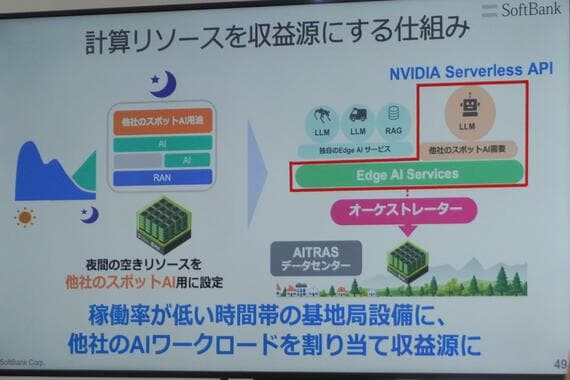

外部企業にAIリソースを提供

もう1つの特徴が、通信トラフィックの少ない時間帯のGPUリソースを外部に提供できる点だ。オーケストレーターは空いているGPUの状況を確認し、NVIDIAが提供するクラウドサービス連携用のAPI(Serverless API)を通じて、他社のAI処理需要を受け入れる。

例えば、ChatGPTのような対話型AI「Llama 3」の利用といったAI処理を、空きリソースの範囲で実行できる。企業は独自のAIインフラを構築する代わりに、通信事業者の基地局設備を利用できる。通信事業者にとっても、基地局設備の稼働率を高めながら、新たな収益機会を得ることができる。

「AIサービスを提供したい企業が、基盤となるインフラ部分を気にせずに開発に集中できる環境を目指している」と山科氏は説明する。

自動運転の分野では、ソフトバンクとトヨタ自動車の合弁会社であるモネ・テクノロジーズと連携。お台場での実証実験データを用いた検証も進めている。

無料会員登録はこちら

ログインはこちら