ChatGPTよりも安全を掲げる"憲法AI"の可能性 AIをトレーニングし安全・無害・誠実な出力を行う

ClaudeのAIモデルは自己監査機能を持ち、出力が倫理原則に違反していないかをチェックする。その結果、敵対的な質問文に対しても適切に(つまり無害な)応答を返すようになる。さらにAIはチャットを通じて継続的に学習するため、自身の応答を調整し、常により高度で安全になるよう改善される。

Constitutional AIの学習に使われた倫理原則は、Anthropicが独自に構築した原則に加え、国連の世界人権宣言やアップルの利用規約などの外部情報源を組み合わせて作成されている。

スピード感ある開発体制

Claudeの最初のリリースは2023年3月だったが、それ以来、スピード感を保ちながらバージョンアップが重ねられており、最近ではOpenAIのChatGPTのライバルのなかでも有力株と評価されるようになってきている。今回のClaude 3.5 Sonnetは、前バージョンのClaude 3.0がリリースされてから、わずか3ヵ月のインターバルで登場している。

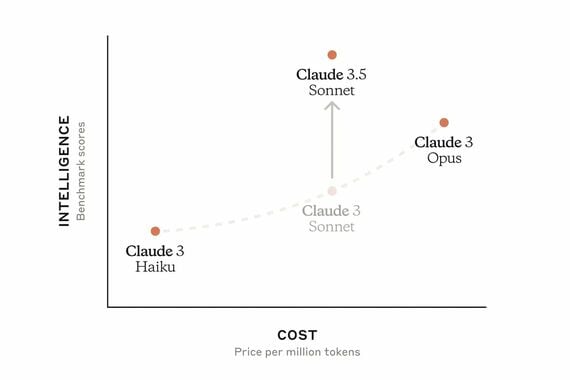

バージョンナンバーの後ろに記されるSonnetという名称は、Claudeファミリーのなかでは中間的なレベルのモデルであることを示す。

このレベルは、文章作成など日常的なAIタスクのほとんどに対応する標準的な機能を備えている。ほかには、エントリー向けで、軽量かつ高速なHaikuと、複雑な数学的処理やプログラムコーディングに強いハイエンド・エンタープライズ向けのOpusが存在する。今回のリリースではまずSonnetだけが公開されており、エントリー向け、ハイエンド・エンタープライズ向けは遅れて登場する予定となっている。

以前のバージョンに比べて、Claude 3.5 Sonnetはニュアンスやユーモア、複雑な指示を理解する能力が著しく向上し、自然で共感できる表現で、高品質なコンテンツを出力できるようになった。

リリースに伴い公開された資料によれば、推論やコーディングといった生成AIにおける主要な比較カテゴリーのいくつかで、GPT-4oやGoogleのGemini 1.5 Pro、MetaのLlamaを上回るスコアを記録している。ただ、その差は数パーセント程度であるため、実際の使用においては、ユーザーがはっきり違いを感じるほどではないだろう。

無料会員登録はこちら

ログインはこちら