ポイントは人の行動履歴を把握することであり、デバイスの中に蓄積された情報の意味を理解することである。

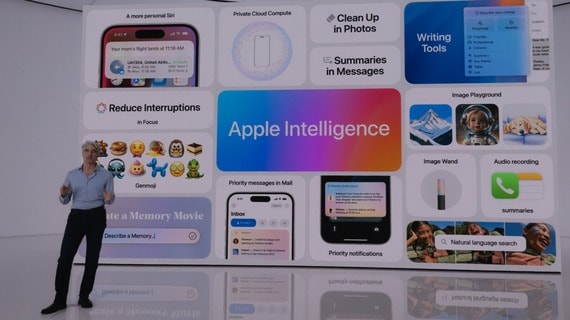

Apple Intelligenceが組み込まれたアップル製品では、過去にやり取りしたメッセージから「先日、妻におすすめされたポッドキャスト」を探して聞くこともできるし、「母が到着する飛行機の時間と、空港の近くにある彼女が好きそうなレストラン」を呼び出すこともできる。

数万件を超える写真の中から「顔にステッカーをつけた娘」の写ったものだけを探すこともできるし、「旅行で撮った写真から、最後が2人のセルフィーで終わる動画を作る」こともできる。

ここで挙げた例は、いずれも人間なら簡単に把握できる内容だが、機械が把握するには使っている人間の行動や文脈を理解しておく必要が出てくる。写真を検索するにも、写真にはそもそもなにが写っているのかを細かく認識して蓄積していなくてはならない。

「オンデバイス生成AI」をトレーニングしていた

確かにこうした分析は生成AIが得意とするものだ。

だが、どれも非常にプライベートな内容であり、解析した結果がネットに流出したり、広告などに使われたりすると大変なことになる。AIの学習に使われることも避けたい。

そのため、機器の使い勝手を上げるAIでは、どのメーカーも機器内だけでAI処理を進めるオンデバイスAIを使って、プライバシーに配慮している。

オンデバイスAIの開発についてはOpenAI独走という状態にはなく、マイクロソフトもGoogleも、そしてMetaもそれぞれ独自に結果を残し始めている。アップルはさらにそこに割って入ることになった。

あまり知られていないが、アップルは2023年に「AXLearnフレームワーク」という技術を公開している。Apple Intelligenceに使われているものだが、公開のさらに数年前から独自開発を進め、Apple Intelligenceで使う「オンデバイス生成AI」をトレーニングしていたという。

無料会員登録はこちら

ログインはこちら