風景や、部屋の光景などを撮っても、それを認識してだいたいの説明をしてくれるところは、普段からChatGPTをお使いの方ならお分かりだろう。

「なんだ、新しいカメラコントロールボタンの長押しで、ChatGPTが使えるようになっただけね」と言われれば、まぁその通りではある。

しかし、この『ワンボタンで生成AIを呼び出せる』というところに、アップルらしさを感じるのだ。『画像をChatGPTにアップロードすれば使える』というのと、『ワンボタンでChatGPTに送られる』というのは同じようで違う。言わば、ChatGPTが目を持ったようなものなのだ。

また、プロンプトの類いはApple Intelligenceが作ってChatGPTに投げる仕組みなのだろう。ユーザーが意識する必要はない。

iPhoneが登場したときに、『従来の携帯(後にガラケーと言われる)にタッチパネルを付けただけ』と言った人は多かったが、実はそれは『コンピューターを持ち歩けるようにした』という革命だったのだ。もしかしたら、アップルはApple Intelligenceで『生成AIを持ち歩けるように』しようとしているのかもしれない。

いわば、生成AIが『目』を持ったという感じ

iPhoneのカメラがChatGPTの目になることで、そこにさまざまな新しい機能が生まれている。

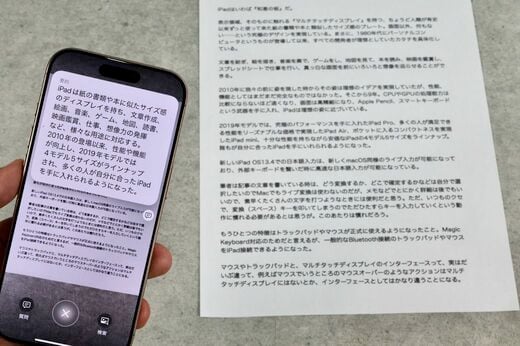

文章を見せて、それを要約させることができる。素早く読めばいい話ではあるが、自分が詳しくない分野の話でも概要を教えてもらえば、細かく読むべきかどうかの判断ができる。ちなみに、この機能はChatGPTではなくApple Intelligence単体の機能なので、Wi-Fiのない飛行機の中など、オンラインでない状態でも動作する可能性が高い。

単純な機能のようだが、これは他言語でも可能だ。長文の英語を読み解くのが大変な人は多いと思うが、概要が分かれば、細かく読むべきかどうかが判断できる。

次ページが続きます