試しにChatGPTの用途として例に上がりやすい「コピーライティング」「スケジュール管理」「プログラミング」「レシピの考案」などの質問を試しましたが、書き出された結果をそのまま信じて使うには危ういものもたくさん含まれていました。

この先はわかりませんが、現状では人間側に書き出されたもの対して、正誤を確かめるための知識と確認作業が必要だと思います。

生成AIを効率的に利用するには、「目的」をどれだけ明確に伝えることができるかが重要です。私がいちばん便利だと感じたプログラミングの生成でも、例えば「ホームページ(HP)を作りたい」と思ったとき、それをそのままを命令として打つと、HTML(Webページを表示するための言語)とCSS(Webページの見た目を設定する言語)への理解が必要であることの説明が書き出されます。

そして「HTMLとCSSで表紙のページのコードを書いてほしい」など、やや具体的な指示と書くと見本のコードを書いてくれます。が、もうこの時点で、HTMLやCSSの知識がない人はAIに何を聞けばいいかわからないのではないでしょうか。

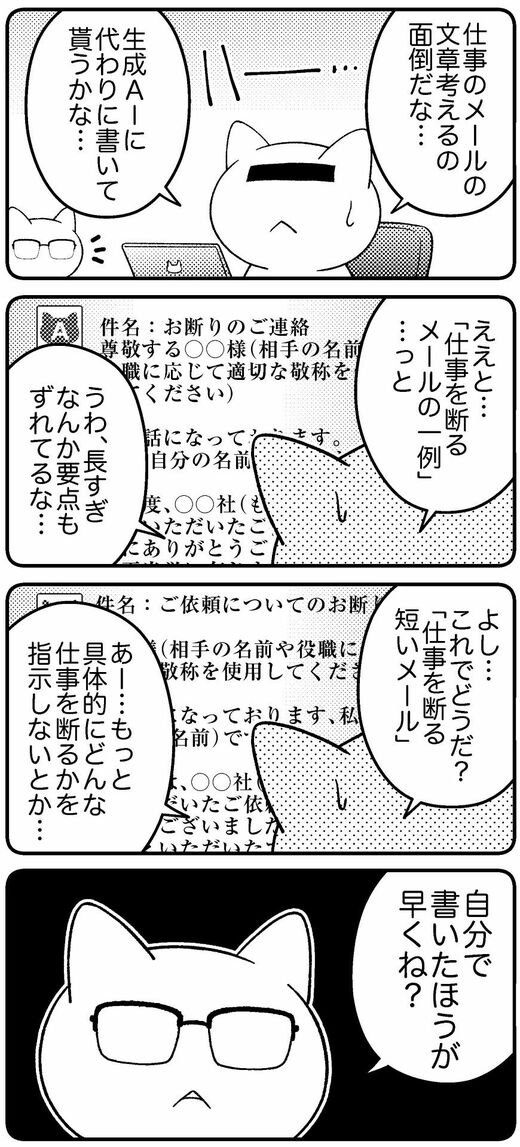

「伝え方」で書き出される精度が変わる

生成AIは目的をどれだけ明確に具体的に伝えるかによって書き出される情報の精度が変わります。

※外部配信先では図を全部閲覧できない場合があります。その際は東洋経済オンライン内でお読みください

実際に仕事で使うようなHPを作るには、もっとさまざまなプログラミング知識が必要ですから、知識のある人が後で修正する前提で、作業時間短縮のために利用するなら使えると思いましたが、知識のない人が自分の代わりに仕事を頼めるかというと、「目的」を正確に伝えられず、求めていた回答も引き出すことができないと思いました。

また、AIが書き出した情報にはうそが混じることがあります。有名な話だと、「○○付近の喫茶店を教えてほしい」などの質問をしたとき、現実にはない店を提案したほか、医療に関する質問では誤診をしたりします。

医療については医療データが個人情報にあたるため、学習できるデータが少ないこともあるのでしょうが、質問者が自分の症状を誤診してAIに目的を伝えたという可能性もあります。

次ページが続きます:

【リスキリングは最小限でいい】