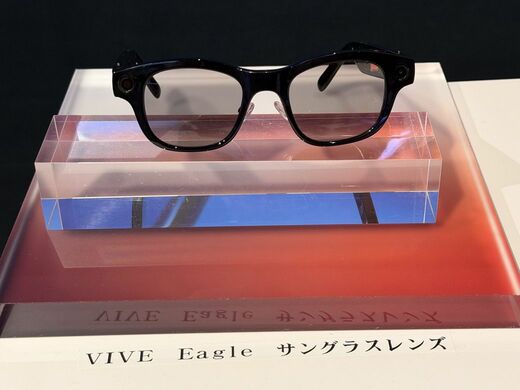

右フレームに1200万画素の超広角カメラを内蔵しており、「Hey VIVE」と呼びかけてから目の前のものを撮影すると、AIが内容を分析して音声で答えてくれる。出張先のレストランでメニューを撮影すれば翻訳が返ってくるし、冷蔵庫の中身を見せてレシピを提案させることもできる。

AIモデルはGoogle GeminiとOpenAI GPT(ベータ版)から選べる。眼鏡のカメラで見たものをAIに聞く体験は、スマートフォンやイヤホンでは代替しにくい。

AIの応答に対して追加で質問したい場面もある。会話継続モードを使えば、約10分間はウェイクワードなしで続けて質問できる。近くのカフェを探してもらい、そのまま評価や行き方を聞くといった使い方が自然にできる。AndroidならGoogleアシスタント、iPhoneならSiriとも連携し、声だけでカレンダーに予定を入れたり音楽を再生したりもできる。

録音機能も備えている。録音した内容はAIが文字起こしと要約を生成する「VIVE AI Notes」機能で整理できる。話者の識別にも対応しており、会議の議事録を眼鏡だけで作れる。月300分まで利用でき、購入時にはこの機能を含む「VIVE AI Plus」の24カ月無料サブスクリプションが付属する。

もちろん、AI機能を使わずにカメラ単体で写真や動画を撮ったり、オープンイヤー型スピーカーで音楽を聴いたりすることもできる。耳をふさがないので周囲の音が聞こえ、ランニング中や移動中でも使いやすい。重さは約49gで、一般的な眼鏡と大きく変わらない。レンズにはドイツのツァイス製UV400光学素材を採用した。

なぜディスプレイではなく「音声AI」なのか

スマートグラスのなかには、レンズに映像を投影するディスプレイ搭載型もある。HTCがあえてディスプレイを載せなかったのは意図的な判断だ。HTC NIPPONの山下賢治事業責任者は発表会後の取材で「現時点のディスプレイ技術では重くなり、消費電力も大きい。ユーザー体験として十分ではない」と説明した。

次ページが続きます:

【印象的なのは軽さと想像以上にしっかりしている音質】