総務省の令和7年版『情報通信白書』によると、日本で何らかの生成AIサービスを「使っている(過去に使ったことがある)」と回答した個人の割合は、2023年度の9.1%から、2024年度には26.7%へと大きく増加しています。

個人向けの生成AIアプリが増えていることに加え、各社が生成AIを活用したサービスの提供を進めていることから、生成AI利用のハードルは、ますます下がっているといえるでしょう。

こうした状況を背景に、業務において個人利用の生成AIを活用するケース、すなわちIT部門等が把握していない状態で従業員が個人的に生成AIを使用する、いわゆる「シャドーAI」が増えていることが指摘されています。

このように、業務効率化や労働時間の短縮が期待される一方で、IT部門等のガバナンスが行き届いていない状態で生成AIが利用されることにより、情報漏えいやコンプライアンス違反など、深刻なリスクが生じる可能性への懸念も高まっています。

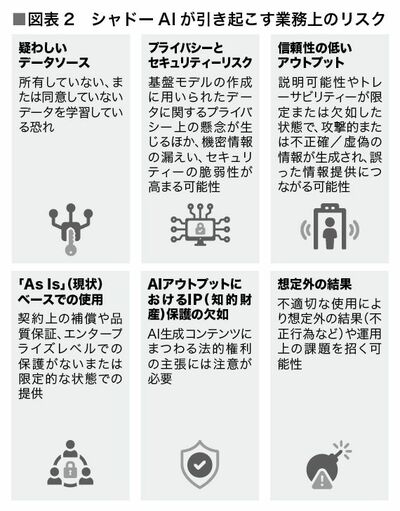

シャドーAIが引き起こす業務上のリスク

シャドーAIによるリスク発生の場面(図表2)には、主にインプットとアウトプットの2つがあります。

まず、インプットに関するリスクです。業務で生成AIを利用する場合、顧客情報や企画書、財務・債務情報、技術情報といった機密情報や個人情報を入力する可能性が高くなります。

個人利用の生成AIアプリは、使用開始時に利用規約への同意を求められるケースが一般的ですが、ベンダーによっては、ユーザーが入力した情報を学習データとして利用したり、第三者に提供したりすることに同意する趣旨の条項が含まれている場合があります。

こうした内容を十分に認識しないまま機密情報や個人情報を入力してしまうと、データが学習に利用されたり、外部に漏えいしたりするリスクが生じます。

次ページが続きます:

【さらに問題となるのは…】