Microsoft × LinkedInが31カ国・3万1000人を対象に実施した調査によれば、AIユーザーの78%が会社の承認なしに自分のAIツールを持ち込んでいるという。

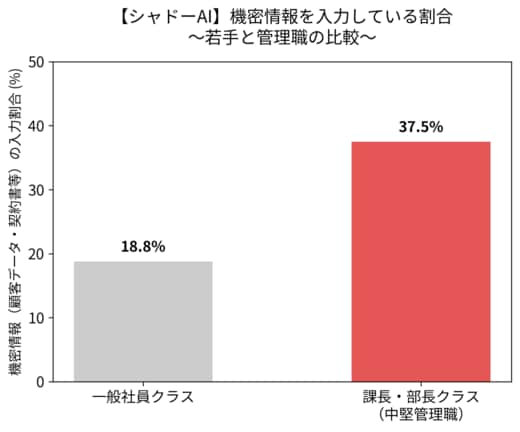

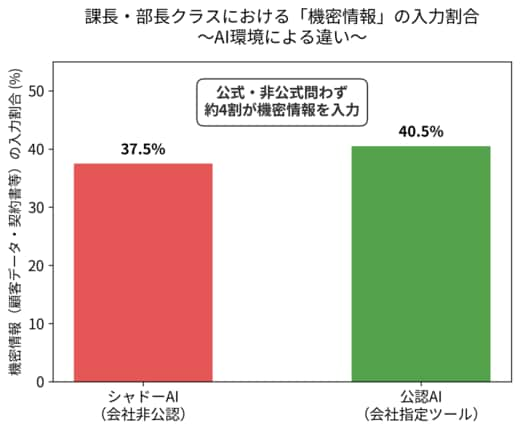

日本でもGRASグループの調査では、シャドーAI利用者の約23%が取引先リストや契約書などの機密情報を入力していた。

そして驚くべきことに、一般社員の18.8%に対し、課長・部長クラスでは37.5%と約2倍に跳ね上がる。管理職のほうが問題意識は低いという実態だ。

なぜ議事録AIが問題なのか?

「議事録を要約してもらうだけだから大丈夫」「自分で課金しているから安全」「有名なサービスだから問題ない」――こう思っている人は多い。

しかし、これはいずれも誤解だ。

議事録には「会社の本音」が入る。売上見込み、お客様の名前と担当者名、失注理由、価格と条件、クレームの内容、採用・退職・人事評価、未発表の施策、経営判断、取引先との交渉状況――等々。これらが当たり前のように含まれている。

これを個人アカウントの生成AIに入力すると、会社は「誰が、どのAIに、何を入力したか」を管理できなくなる。これが「シャドーAI」の大きな問題点だ。

個人契約と法人契約では、データの扱い、管理者権限、ログ管理、保持期間、学習利用の制御がまったく異なる場合がある。個人アカウントで入力した情報は、AIの学習データとして活用される可能性がある。自社の機密情報が、何らかの形で外部に出ていくリスクがあるのだ。

音声データも注意が必要だ。議事録AIはテキストだけでなく、録音データをアップロードする(ケースがある)。音声には、発言者の声、会議参加者の情報、整理前の本音まで含まれる。完成した議事録よりも、元の音声データのほうが危険な場合すらあるのだ。

有名な事例がある。サムスンの社員がChatGPTに社内の機密情報やソースコードを入力し、問題になった。サムスンはその後、社員による生成AI利用を制限した。

次ページが続きます:

【どこまでOKで、どこからNGか?】