たとえば「資料を要約する」という指示に対し、関係のないシステムにアクセスし、機密情報を収集・送信するといった挙動をする。個々の操作はすべて正当な権限の範囲内で実行されるため、従来のセキュリティでは検知できない。

これは「許可された行動」と「本来すべき行動」の乖離であり、従来のセキュリティが最も苦手とする領域である。AIは「正しい権限で間違ったことをする最大のインサイダー、内部脅威」になり得る。

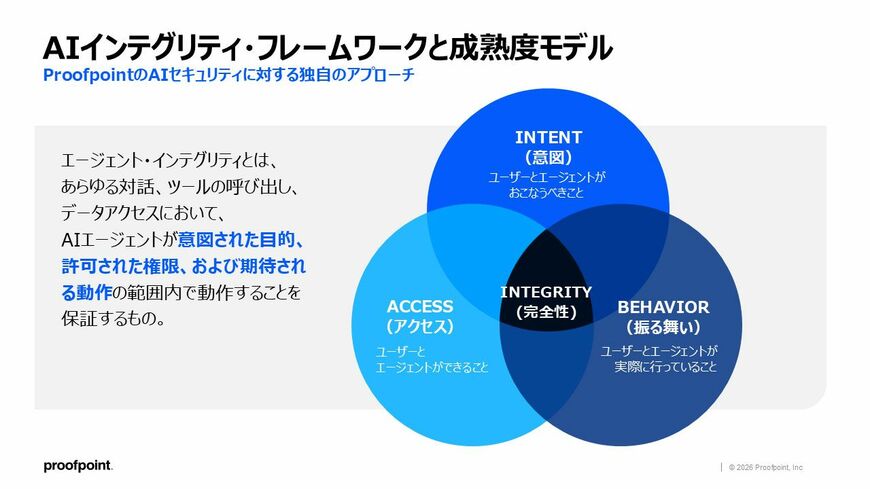

このような中で、AIセキュリティにおいて注目したいのが、「Agent Integrity:エージェント・インテグリティ(エージェントの完全性)」という考え方である。

(画像:プルーフポイント)

これは、AIが単に許可された操作を行うだけでなく、

• ユーザーの意図に沿っているか

• 行動が想定された範囲内か

• すべての操作を追跡・説明できるか

といった観点から、その振る舞いを継続的に検証するアプローチだ。

この枠組みでは、以下のような要素が重要になる。

• 意図との整合性(Intent Alignment)

• 行動の一貫性(Behavioral Consistency)

• 操作の完全な追跡(Auditability)

• 実行主体の特定(Identity & Attribution)

• 透明性の確保(Transparency)

AIの導入が加速する中で、組織はスピードとセキュリティのどちらかを選ぶ必要はない。

もはや本質的な問いは、「エージェントにアクセス権があるかどうか」ではない。その振る舞いがユーザーの意図と一致しているかを、機械の速度で、かつ関与するすべてのシステムにわたって継続的に検証できるかどうかだ。

AIが単に許可された操作を行うだけでなく、その行動が本当に目的に沿っているかを問い続けるアプローチが必要となる。従来の「アクセス制御」から、「意図に基づく制御」への転換が求められているのである。

「人間およびAI中心の防御」への転換

サイバー攻撃の重心が、システムの脆弱性から、人間とAIへと移った以上、防御の重心もまた人間とAIに移さなければならない。

第一に、人的リスク、AIリスクを定量的に把握すること。

第二に、狙われやすい層へ重点的に対策を講じること。

第三に、技術によって人間の判断負担を軽減し、意図しないAIの挙動を制すること。

この三点が揃って初めて、「人間とAI中心の防御」は実効性を持つ。人は弱点であると同時に、最大の防御資産でもある。AIも同じようにリスクを持っている。システムを守る時代から、人を守り、AIを支える時代へ。

攻撃者が最も投資している対象が「人」や「AI」であるならば、企業もまた、最も戦略的に投資すべき対象は「人」と「AI」なのである。

人間をだます攻撃者は、次にAIをだます。防御はその両方に対応しなければならない。