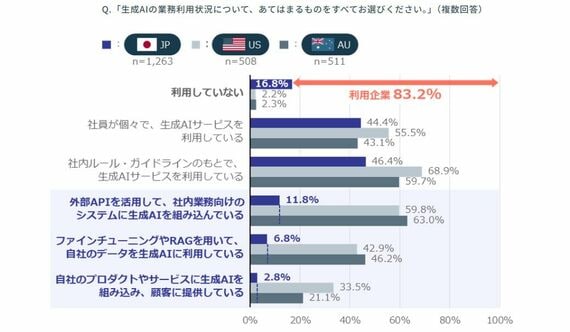

AIがシステムと連携し始めた先にあるのは、AIが自律的に外部ツールを操作して業務を代行する「AIエージェント化」の波です。日本企業も遠からず、AIを単なるチャットツールとして使う段階から、このフェーズへと本格的に突入していくでしょう。

しかし、セキュリティ対策の実態は追いついていません。同調査では、データ露出などのリスクが懸念されるAIサービスに対して「技術的な調査・監視」を行っている日本企業はわずか6.6%にとどまり、62.4%が「未対策」であることがわかっています。

社内ルールを定めただけでは、AIエージェントの自律的な挙動や、システム間で連鎖する攻撃を防ぐことは不可能です。

国内でも「切実な相談」が急増中

当社のコンサルティングや診断の現場でも、状況はアンケート実施時よりもさらに加速度的に変化しています。これまで生成AIのセキュリティ相談といえば、社内文書を参照するRAG(検索拡張生成)システムに関するものが中心でした。

しかし最近では、外部システムと連携して動く「AIエージェント」に対する「AI Red Team(疑似攻撃テスト)」や「設計段階でのセキュリティ評価」の依頼が急増しています。さらに「どんなリスクがあるのか把握できず、ガバナンスの枠組みが作れない」という切実な声も寄せられています。

共通しているのは、「AIエージェントには、従来のセキュリティの枠組みではカバーしきれない未知のリスクがある」という強い危機感です。

次ページが続きます:

【著名なサービスでセキュリティ問題が続出】